資訊專欄INFORMATION COLUMN

摘要:我們還經(jīng)驗性地演示了貝葉斯在語言建模基準和生成圖說任務(wù)上優(yōu)于傳統(tǒng),以及通過使用不同的訓(xùn)練方案,這些方法如何改進我們的模型。第節(jié)和第節(jié)分別回顧了通過反向傳播做貝葉斯,和通過時間做反向傳播。

摘要

在這項工作里,我們探討了一種用于 RNN 的簡單變分貝葉斯方案(straightforward variational Bayes scheme)。首先,我們表明了一個通過時間截斷反向傳播的簡單變化,能夠得出良好的質(zhì)量不確定性估計和優(yōu)越的正則化結(jié)果,在訓(xùn)練時只需花費很小的額外計算成本。其次,我們展示了一種新的后驗近似,能夠如何進一步改善貝葉斯 RNN 的性能。我們將局部梯度信息合并到近似后驗,以便在當(dāng)前批次統(tǒng)計數(shù)據(jù)周圍對其進行銳化。這種技術(shù)并不僅限于循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN),還可以更廣泛地應(yīng)用于訓(xùn)練貝葉斯神經(jīng)網(wǎng)絡(luò)。我們還經(jīng)驗性地演示了貝葉斯 RNN 在語言建模基準和生成圖說任務(wù)上優(yōu)于傳統(tǒng) RNN,以及通過使用不同的訓(xùn)練方案,這些方法如何改進我們的模型。 我們還引入了一個新的基準來研究語言模型的不確定性,便于未來研究的對比。

?

背景:將貝葉斯方法用于訓(xùn)練,增加 RNN 不確定性和正則化

循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)在一系列廣泛的序列預(yù)測任務(wù)上取得了業(yè)內(nèi)較高水平的性能(Wu et al., 2016; Amodei et al., 2015; Jozefowicz et al., 2016; Zaremba et al., 2014; Lu et al., 2016)。在這項工作中,我們將通過將貝葉斯方法用于訓(xùn)練,考察如何在 RNN 中增加不確定性和正則化。

貝葉斯方法為 RNN 提供了另一種表達不確定性的方法(通過參數(shù))。同時,使用一個先驗(prior)將各種參數(shù)整合,使許多模型在訓(xùn)練期間平均化,使網(wǎng)絡(luò)實現(xiàn)正則化的效果。近來,有的方法試圖將 dropout(Srivastava et al,2014)和權(quán)重衰減證明為一種變分推理的方案(Gal&Ghahramani,2016),或者應(yīng)用隨機梯度 Langevin dynamics(Welling&Teh,2011,SGLD)在時間上直接截斷反向傳播(Gan et al,2016)。?

四大貢獻

有趣的是,最近的工作還沒有進一步研究像 Graves(2011)所做的那樣,直接應(yīng)用變分貝葉斯推理方案(Beal,2003)。(注釋:原文沒有提到 Graves 2011 年的工作,這里是有人在 Reddit 上指出后,Oriol Vinyals 立即做的修改。)

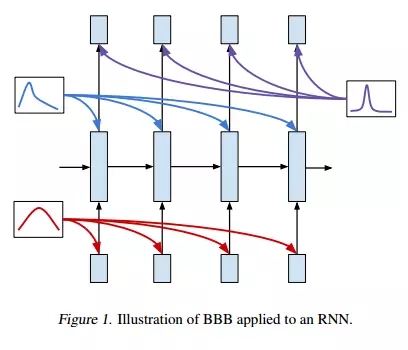

我們在(Blundell et al,2015)Bayes by Backprop 工作的基礎(chǔ)上,提出了一個簡單直接的方法,經(jīng)過實驗表明能夠解決很大規(guī)模的問題。

我們的方法是對通過時間截斷反向傳播的一個簡單改變,得到了對 RNN 權(quán)重后驗分布的估計。

將貝葉斯方法應(yīng)用于成功的深度學(xué)習(xí)模型有兩大好處:對不確定性和正則化的明確表征。我們的公式明確地導(dǎo)出了一個有信息理論支撐的成本函數(shù)(cost function)。

變分推理后驗的形式?jīng)Q定了不確定性估計的質(zhì)量,從而影響著模型的整體表現(xiàn)。我們將展示如何在批次的局部調(diào)整(“銳化”)后驗,提高 RNN 的性能。這種銳化使用基于批次的梯度來調(diào)整一個批次數(shù)據(jù)的變分后驗。這一過程可以被視為層次化分布(hierarchical distribution),其中局部批次梯度被用于調(diào)整全局的后驗,在每個批次都形成一個局部近似。

將變分推理應(yīng)用于神經(jīng)網(wǎng)絡(luò)時,這為高斯后驗(Gaussian posterior)的典型假設(shè)提供了更靈活的形式,減小了方差(variance)。這種技術(shù)可以在其他變分貝葉斯模型中更廣泛地應(yīng)用。

我們展示了如何將 Backprop By Bayes(BBB)有效應(yīng)用于 RNN。

我們開發(fā)了一種減少 BBB 方差的新技術(shù),可以被廣泛地用于其他較大似然框架當(dāng)中。

我們在兩項經(jīng)過廣泛研究的基準上提高了測試結(jié)果,性能大幅超越了現(xiàn)有的正則化技術(shù),比如 dropout。

我們?yōu)檠芯空Z言模型的不確定性提出了新的基準。

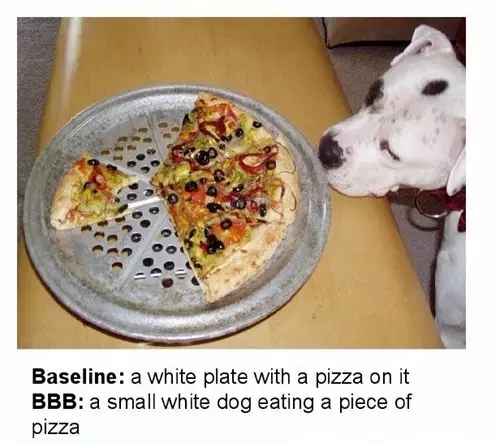

實驗結(jié)果:圖說生成超越現(xiàn)有基準

作者在論文中給出了他們新方法在圖說生成在 MSCOCO 上與此前方法的對比。可以看出,BBB 相較以前的結(jié)果有顯著提升。

論文的其余部分組織如下。第 2 節(jié)和第 3 節(jié)分別回顧了通過反向傳播做貝葉斯(Bayes by Backprop,BBB)和通過時間做反向傳播(Backprop through time)。第 4 節(jié)推導(dǎo)出了用于 RNN 的 Bayes by Backprop,而第 5 節(jié)描述了后驗的銳化。第 6 節(jié)簡要回顧了相關(guān)工作。第 7 節(jié)做了實驗評估,最后在第 8 節(jié)進行討論并得出結(jié)論。

論文地址:https://arxiv.org/abs/1704.02798

歡迎加入本站公開興趣群商業(yè)智能與數(shù)據(jù)分析群

興趣范圍包括各種讓數(shù)據(jù)產(chǎn)生價值的辦法,實際應(yīng)用案例分享與討論,分析工具,ETL工具,數(shù)據(jù)倉庫,數(shù)據(jù)挖掘工具,報表系統(tǒng)等全方位知識

QQ群:81035754

文章版權(quán)歸作者所有,未經(jīng)允許請勿轉(zhuǎn)載,若此文章存在違規(guī)行為,您可以聯(lián)系管理員刪除。

轉(zhuǎn)載請注明本文地址:http://specialneedsforspecialkids.com/yun/4527.html

摘要:康納爾大學(xué)數(shù)學(xué)博士博士后則認為,圖神經(jīng)網(wǎng)絡(luò)可能解決圖靈獎得主指出的深度學(xué)習(xí)無法做因果推理的核心問題。圖靈獎得主深度學(xué)習(xí)的因果推理之殤年初,承接有關(guān)深度學(xué)習(xí)煉金術(shù)的辯論,深度學(xué)習(xí)又迎來了一位重要的批評者。 作為行業(yè)的標(biāo)桿,DeepMind的動向一直是AI業(yè)界關(guān)注的熱點。最近,這家世界最較高級的AI實驗室似乎是把他們的重點放在了探索關(guān)系上面,6月份以來,接連發(fā)布了好幾篇帶關(guān)系的論文,比如:關(guān)系歸...

摘要:年以來,深度學(xué)習(xí)方法開始在目標(biāo)跟蹤領(lǐng)域展露頭腳,并逐漸在性能上超越傳統(tǒng)方法,取得巨大的突破。值得一提的是,目前大部分深度學(xué)習(xí)目標(biāo)跟蹤方法也歸屬于判別式框架。 開始本文之前,我們首先看上方給出的3張圖片,它們分別是同一個視頻的第1,40,80幀。在第1幀給出一個跑步者的邊框(bounding-box)之后,后續(xù)的第40幀,80幀,bounding-box依然準確圈出了同一個跑步者。以上展示的其...

摘要:因為深度學(xué)習(xí)的正統(tǒng)觀念在該領(lǐng)域已經(jīng)很流行了。在機器和深度學(xué)習(xí)空間中進行的大多數(shù)數(shù)學(xué)分析傾向于使用貝葉斯思想作為參數(shù)。如果我們接受了目前深度學(xué)習(xí)的主流觀點任何一層的微分都是公平的,那么或許我們應(yīng)該使用存儲多種變體的復(fù)分析。 深度學(xué)習(xí)只能使用實數(shù)嗎?本文簡要介紹了近期一些將復(fù)數(shù)應(yīng)用于深度學(xué)習(xí)的若干研究,并指出使用復(fù)數(shù)可以實現(xiàn)更魯棒的層間梯度信息傳播、更高的記憶容量、更準確的遺忘行為、大幅降低的網(wǎng)...

摘要:摘要在年率先發(fā)布上線了機器翻譯系統(tǒng)后,神經(jīng)網(wǎng)絡(luò)表現(xiàn)出的優(yōu)異性能讓人工智能專家趨之若鶩。目前在阿里翻譯平臺組擔(dān)任,主持上線了阿里神經(jīng)網(wǎng)絡(luò)翻譯系統(tǒng),為阿里巴巴國際化戰(zhàn)略提供豐富的語言支持。 摘要: 在2016年Google率先發(fā)布上線了機器翻譯系統(tǒng)后,神經(jīng)網(wǎng)絡(luò)表現(xiàn)出的優(yōu)異性能讓人工智能專家趨之若鶩。本文將借助多個案例,來帶領(lǐng)大家一同探究RNN和以LSTM為首的各類變種算法背后的工作原理。 ...

摘要:舉例,神經(jīng)元,感知機,神經(jīng)網(wǎng)絡(luò)行為主義智能機器人認為人工智能源于控制論。人工智能的研究領(lǐng)域包括專家系統(tǒng)推薦系統(tǒng)等等。是一種實現(xiàn)人工智能的方法根據(jù)某些算法,通過大量數(shù)據(jù)進行訓(xùn)練和學(xué)習(xí),然后對真實世界中的事件做出決策和預(yù)測。 1. 緒論 四大流派 符號主義(知識圖譜)原理主要為物理符號系統(tǒng)(即符號操作系統(tǒng))假設(shè)和有限合理性原理 用數(shù)理邏輯描述智能行為, 在計算機上實現(xiàn)了邏輯演繹系統(tǒng)。 ...

閱讀 3076·2023-04-25 20:43

閱讀 1719·2021-09-30 09:54

閱讀 1590·2021-09-24 09:47

閱讀 2874·2021-09-06 15:02

閱讀 3510·2021-02-22 17:09

閱讀 1233·2019-08-30 15:53

閱讀 1441·2019-08-29 17:04

閱讀 1956·2019-08-28 18:22