資訊專欄INFORMATION COLUMN

摘要:生物學上合理的認知計算模型用梯度下降算法訓練的經典認知計算模型需要將基于準確的前饋神經元突觸權重的誤差信號反向傳播,這在生物學的神經系統中被認為是不可能的。

反向傳播(BP)算法被認為是用于訓練深度神經網絡的“事實上”(de-facto)的方法。它使用前饋權重的轉置,以較精確的方式將輸出層的誤差反向傳播到隱藏層。然而,有人認為,這在生物學上是不合理的,因為在生物神經系統中,帶有準確輸入權重的誤差信號的反向傳播被認為是不可能的。在本研究中,基于神經科學和與BP 類似的不對稱方法的相關文獻,研究者提出了一種在生物學上合理的神經結構范式。具體來說,研究者提出了兩種具有可訓練前饋和反饋權重的雙向學習算法。前饋權重用于將 activation 從輸入中繼到目標輸出。反饋權重則將誤差信號從輸出層傳遞到隱藏層。與其他和BP類似的不對稱方法不同,反饋權重在框架中也很易變,并且被訓練來逼近 forward activition。初步結果表明,研究提出的模型在 MNIST 和 CIFAR-10 數據集上優于其他和BP類似的不對稱方法。

論文導讀

反向傳播(BP)算法是反向模式自動分化和最速下降法的結合,它被認為是用于訓練深度神經網絡(DNN)的方法。它以較精確的方式將誤差從輸出層逐層反向傳播到輸入層。然而,有人認為,在生物學上,大腦中涉及較精確的對稱反向信道的學習是不可能的。

在深度學習的早期階段,先使用 Boltzmann 機器進行無人監督的預訓練,然后再用 BP 進行微調,不涉及對稱權重,且是基于生物學機制的。最近,關于開發生物學上可行且實用的 BP 替代方案的研究越來越多。

另一方面,歸因于神經科學類的文獻,長期增強(LTP)被認為是人類記憶和學習的重要一步。如在LTP 中引入的,神經元之間的強聯系從神經調節步驟開始,其中一個神經元將更多的離子受體移動到其樹突的膜上。結果就是,更多的離子被捕獲,從而放大了電脈沖。

?

基于LTP 的原理和反饋權重易變這一假設,我們提出了一種在生物學層面更合理的感知范式和兩個雙向學習模型。在這些雙向學習模型中,前饋權重在正向相位調整,反饋權重在后向階段被學習。我們提出的模型消除了反饋權重必須是隨機和固定的假設。反饋權重被訓練來逼近訓練期間的前向激活。基準數據集的實驗表明,我們的模型優于使用固定反饋權重來傳輸誤差信號的 FA (feedback-alignment model)和 DFA(direct feedback-alignment model)。我們還提供了關于為什么使用自適應權重傳輸誤差信號優于使用固定權重的初步分析。據我們所知,這是表明自適應非對稱反饋信道比 DNN 中的隨機和固定反饋信道更有效的首次研究嘗試。

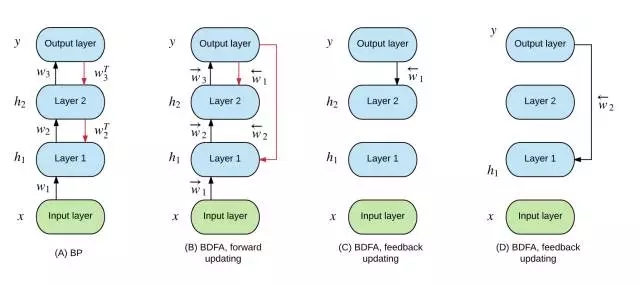

圖1:BP(Back-propagation)、FA(feedback-alignment)和 DFA (direct feedback-alignment)模型。黑色箭頭代表正向激活路徑。紅色箭頭表示誤差(梯度)傳播路徑。

傳統帶有 BP、FA 和 DFA 的 DNN 是單向的,意味著它們只是學習如何將輸入描繪成目標輸出。本研究基于神經科學的相關文獻,提出了一種生物學上合理的計算機認知模型,并繼而提出了雙向反饋比對(bidirectional feedback alignment,BFA)和雙向直接反饋比對(bidirectional direct feedbackalignment,BDFA)模型,分別用針對前向和后向進程的兩組可訓練權重連接神經元。

生物學上合理的認知計算模型

用梯度下降算法訓練的經典認知計算模型需要將基于準確的前饋神經元突觸權重的誤差信號反向傳播,這在生物學的神經系統中被認為是不可能的。另一方面,長時程增強(LTP)被認為是生物學中記憶和認知科學中學習的基本要素。

長時程增強

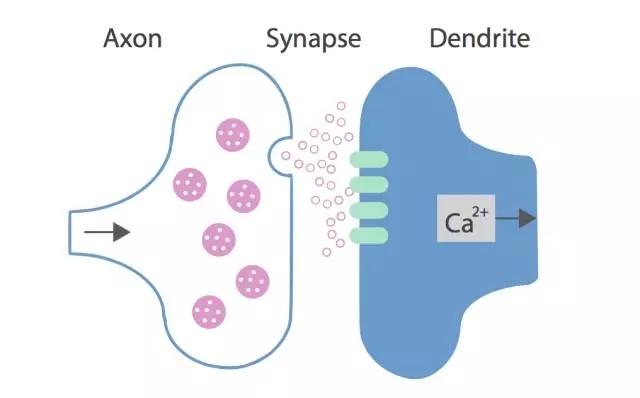

生物神經元由神經元突觸連接,包括軸突和樹突,其中軸突發射信號,下一個神經元的樹突則接收由軸突發射出的信號。然而,軸突和樹突被突觸間隙分開,軸突通過向突觸間隙中釋放離子來發送電脈沖,離子則被樹突細胞膜上的感受器捕獲。結構如下圖:

圖2:軸突和樹突之間的神經連接架構

BioPP 模型的組件如下:

?信號

BioPP 架構中有兩套信號:前饋信號——信號在網絡中正向傳播,應對推理任務;錯誤信號——信號向后傳播,用于調節突觸權重

?權重

權重代表了認知計算模型決定從輸入或相鄰神經元中捕獲的信號數量。應該指出,認知計算模型采用的誤差信號數量也是由其自身決定的。BioPP 會基于輸入中的誤差信號,調整其自身的權重,然后再將誤差信號發送給其他神經元。

? 激活和偏差

激活和偏差的定義和用 BP 訓練的標準 DNN 中的相關定義沒有什么差別。

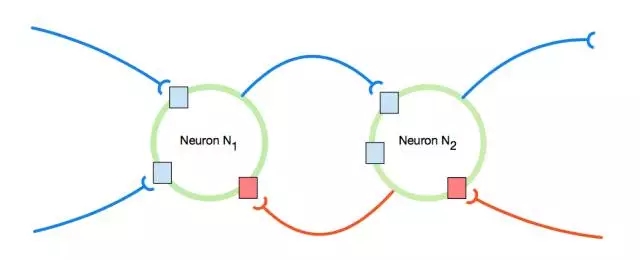

BioPP 的架構如圖 3 所示,其中綠色的圈是神經元,藍色的曲線代表前向突觸,紅色的曲線代表著后向突觸。藍色的方塊和紅色的方塊分別是前向突觸和后向突觸的感知器。值得一提的是,根據 BioPP 的定義,權重是由感知器來調整的。

圖3:2 個BioPP之間的神經元連接的架構

BioPP 有三個限制:

在輸入權重時,誤差信號不能被計算,因為軸突勢單向地傳遞神經信號;

基于內部或外部的誤差信號,神經元可以在本地學習其權重;

所有輸入的權重應該具有自適應性。

FA 和 DFA 中提出的神經模型和 BioPP (其中一些權重是固定的)原則不完全相合。下面我們以 BioPP 原則為基礎,優化 FA 和 DFA 的反饋權重,并在基準數據集測試模型。

雙向訓練 BioPP 網絡

FA 和 DFA 都使用固定隨機權重來傳遞誤差信號,以此訓練神經網絡。在 BioPP 中,我們使得權重能夠像一般輸入權重那樣具有自適應性。

圖4:雙向反饋比對(BFA)。黑色箭頭代表前向激活路徑。紅色箭頭表示誤差(梯度)傳播路徑。

BFA 的整體流程見圖4。BFA 的主要思路是當訓練一組權重時,誤差信號通過其他組權重在網絡中逐層傳遞。BFA 滿足了 BioPP 的原則和限制。BFA 和目標傳播(TP)間的區別是,BFA 學習輸入特征,并逐層傳播誤差信號。而 TP 中的各層則還在用自編碼網絡(Autoencoder)學習前一層的輸入。

圖5:雙向直接反饋比對(BDFA)。黑色箭頭代表前向激活路徑。紅色箭頭表示誤差(梯度)傳播路徑。

BDFA 的總體流程如圖5 所示。BDFA 模型的總體思路是,每個隱藏層多帶帶計算損失,并更新相應的、連接隱藏層和輸入層的反饋權重矩陣。

?

接下來,研究者又分析了為什么應用于雙向訓練模型中的自適應反饋權重總體上說比固定反饋權重表現更好,并證明了如果反饋權重可以更好地學習描寫輸入特征和輸出特征,訓練的整體表現就會得到提升。之后,研究者又對在基準數據集上,在不同超參數設定的條件下, BFA 和 BDFA ?的性能是否超過了 FA 和 DFA。

?

在論文的最后,研究者指出該研究是據他們所知的第一次研究嘗試,來論證在DNN 中,自適應非對稱反饋信道比隨機固定信道要更有效。盡管現在還不清楚大腦是否實施了自適應反饋這一特殊形式,該研究仍然朝著更好理解大腦如何支持從誤差信號中學習這一方向邁出了重要的一步。

?

原文鏈接:https://arxiv.org/abs/1702.07097

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://specialneedsforspecialkids.com/yun/4517.html

摘要:近幾年以卷積神經網絡有什么問題為主題做了多場報道,提出了他的計劃。最初提出就成為了人工智能火熱的研究方向。展現了和玻爾茲曼分布間驚人的聯系其在論文中多次稱,其背后的內涵引人遐想。 Hinton 以深度學習之父 和 神經網絡先驅 聞名于世,其對深度學習及神經網絡的諸多核心算法和結構(包括深度學習這個名稱本身,反向傳播算法,受限玻爾茲曼機,深度置信網絡,對比散度算法,ReLU激活單元,Dropo...

摘要:多加了這兩層卷積層和匯集層是卷積神經網絡和普通舊神經網絡的主要區別。卷積神經網絡的操作過程那時,卷積的思想被稱作權值共享,也在年和關于反向傳播的延伸分析中得到了切實討論。 導讀:這是《神經網絡和深度學習簡史》第二部分,這一部分我們會了解BP算法發展之后一些取得迅猛發展的研究,稍后我們會看到深度學習的關鍵性基礎。神經網絡獲得視覺隨著訓練多層神經網絡的謎題被揭開,這個話題再一次變得空前熱門,羅森...

摘要:導讀這是神經網絡和深度學習簡史第一部分。實際上,神經網絡準確的說應該是人工神經網絡,就是多層感知機今天感知機通常被稱為神經元而已,只不過在這個階段,只有一層輸出層。多層輸出的神經網絡也可以想象一個與感知機不同的人工神經網絡。 導讀:這是《神經網絡和深度學習簡史》第一部分。這一部分,我們會介紹1958年感知機神經網絡的誕生,70年代人工智能寒冬以及1986年BP算法讓神經網絡再度流行起來。深度...

摘要:在普通的全連接網絡或中,每層神經元的信號只能向上一層傳播,樣本的處理在各個時刻獨立,因此又被成為前向神經網絡。不難想象隨著深度學習熱度的延續,更靈活的組合方式更多的網絡結構將被發展出來。 從廣義上來說,NN(或是更美的DNN)確實可以認為包含了CNN、RNN這些具體的變種形式。在實際應用中,所謂的深度神經網絡DNN,往往融合了多種已知的結構,包括卷積層或是LSTM單元。這里的DNN特指全連接...

閱讀 2384·2023-04-25 19:27

閱讀 3494·2021-11-24 09:39

閱讀 3910·2021-10-08 10:17

閱讀 3401·2019-08-30 13:48

閱讀 1936·2019-08-29 12:26

閱讀 3126·2019-08-28 17:52

閱讀 3541·2019-08-26 14:01

閱讀 3538·2019-08-26 12:19