資訊專欄INFORMATION COLUMN

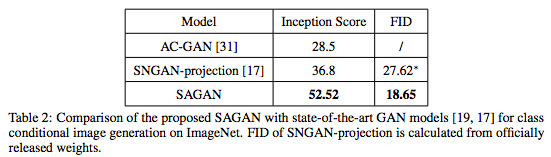

摘要:在這項工作中,我們提出了自注意力生成對抗網絡,它將自注意力機制引入到卷積中。越高,表示圖像質量越好。表將所提出的與較先進模型進行比較,任務是上的類別條件圖像生成。

圖像合成(Image synthesis)是計算機視覺中的一個重要問題。隨著生成對抗網絡(GAN)的出現,這個方向取得了顯著進展。基于深度卷積網絡的GAN尤其成功。但是,通過仔細檢查這些模型生成的樣本,可以觀察到,在ImageNet這類的有許多圖像類別的數據集上訓練時,卷積GAN合成的圖像不盡如人意。

針對這個問題,谷歌大腦的Ian Goodfellow和Augustus Odena,以及羅格斯大學的Han Zhang和Dimitris Metaxas等人在他們的研究中提出“自注意力生成對抗網絡”(SAGAN),將自注意力機制(self-attention mechanism)引入到卷積GAN中,作為卷積的補充,取得了最優的結果。

摘要

在這篇論文中,我們提出自注意力生成對抗網絡( Self-Attention Generative Adversarial Network ,SAGAN)。SAGAN允許對圖像生成任務進行注意力驅動、長相關性的建模。傳統的卷積GAN生成的高分辨率細節僅作為在低分辨率特征圖上的空間局部點的函數。在SAGAN中,可以使用來自所有特征位置的線索來生成細節。此外,鑒別器可以檢查圖像的遠端部分的高度詳細的特征彼此一致。此外,最近的研究表明,生成器條件會影響GAN的性能。利用這些發現,我們將譜歸一化到GAN生成器中,并發現這改進了訓練動態。我們提出的SAGAN達到了state-of-the-art的結果,將Inception score從當前較高的36.8提高到52.52,并且在具有挑戰性的ImageNet數據集上將Frechet Inception distance從27.62降低到18.65。注意力層的可視化表明,生成器利用與對象形狀相對應的鄰域,而不是固定形狀的局部區域。

SAGAN:將自注意力機制引入GAN

盡管較先進的ImageNet GAN模型 [17] 擅長合成幾乎沒有結構性限制的圖像類別(例如,海洋、天空和景觀類,它們的區別更多在于紋理而不是幾何結構),但它無法捕獲在某些類別中經常出現的幾何模式或結構模式(例如,狗通常有逼真的皮毛紋理,但沒有明確區分的腳)。

一種可能的解釋是,以前的模型嚴重依賴于卷積來建模不同圖像區域之間的依賴關系。由于卷積運算符具有一個局部感受域,所以在經過幾個卷積層之后,只能處理長距離的相關性。

由于各種原因,這可能會阻止學習長相關性(long-term dependencies):小的模型可能無法表示它們,優化算法可能無法發現參數值,這些參數值仔細協調多個層,以捕獲這些相關性,并且這些參數化在統計學上可能相當脆弱,當應用于以前未見過的輸入時容易失敗。增加卷積核的大小可以提高網絡的表征能力,但這樣做也會失去利用局部卷積結構獲得的計算和統計效率。

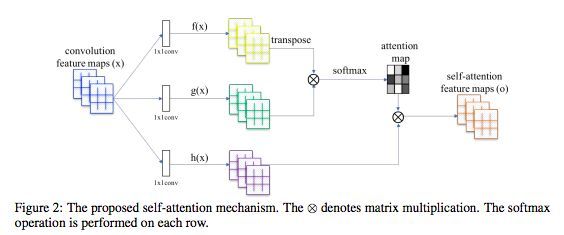

另一方面,自注意力(Self-attention)可以更好地平衡模型的長相關性和計算與統計效率。self-attention模塊以所有位置的特征加權和來計算響應,其中權重(或attention vectors)只以很小的計算成本來計算。

圖 1:我們提出的SAGAN通過利用圖像遠端部分的互補特征來生成圖像,而不是固定形狀的局部區域,從而可以生成一致的對象/場景。圖中每一行的第一個圖像顯示了帶顏色編碼點的五個代表性查詢位置。其他五個圖像是針對這些查詢位置的 attention maps,其中對應的顏色編碼的箭頭概括了更受關注的區域。

在這項工作中,我們提出了自注意力生成對抗網絡(SAGAN),它將自注意力機制(self-attention mechanism)引入到卷積GAN中。自注意力模塊(self-attention module)是對卷積的補充,有助于模擬跨越圖像區域的長距離、多層的依賴關系。通過self-attention,生成器可以繪制圖像,所繪制圖像中每個位置的精細細節都與圖像遠端的精細細節充分協調。此外,鑒別器還可以更準確地對全局圖像結構執行復雜的幾何約束。

圖2:所提出的self-attention機制。?表示矩陣乘法,在每一行上執行softmax操作。

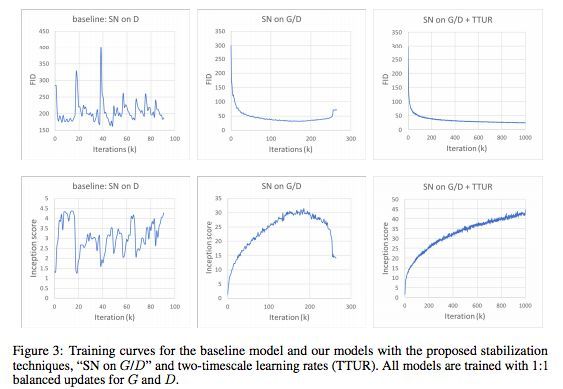

除了self-attention之外,我們還將最近關于網絡調節(network conditioning)的見解與GAN的性能結合起來。A. Odena等人的研究[18]表明,調節良好的生成器往往表現更好。我們建議使用以前僅應用于鑒別器的譜歸一化技術(spectral normalization)來加強GAN生成器器的調節。

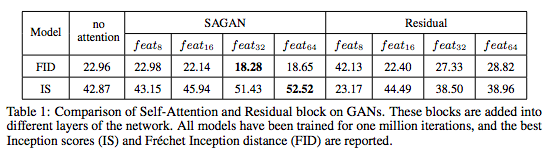

我們在ImageNet數據集上進行了大量的實驗,以驗證所提出的self-attention機制和穩定技術的有效性。SAGAN在圖像合成方面的表現遠遠超過了state-of-the-art的表現,將此前報告的較高Inception score從36.8提高到52.52,將Fréchet初始距離(Fréchet Inception distance,FID)從27.62降低到18.65。attention層的可視化顯示,生成器利用與對象形狀相對應的區域,而不是固定形狀的局部區域。

ImageNet上的圖像合成實驗

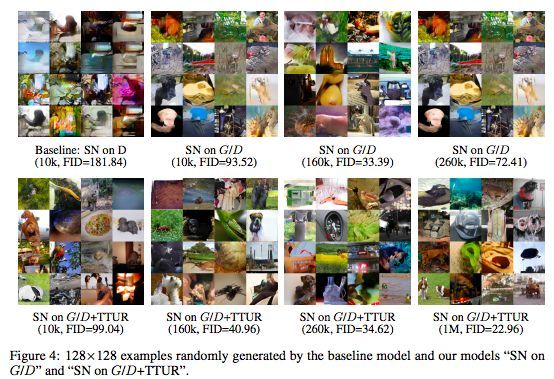

為了評價所提出的方法,我們在LSVRC 2012 (ImageNet)上數據集進行了大量的實驗。首先,我們對評估所提出的兩種穩定GAN訓練的技術進行有效性實驗。其次,對所提出的self-attention mechanism進行了研究。最后,將SAGAN與其他state-of-the-art的圖像生成方法進行了比較。

評估指標

我們使用Inception score(IS)和Fréchet初始距離(FID)進行定量評估。Inception score越高,表示圖像質量越好。 FID是一個更加基于規則和綜合性的指標,并且在評估生成的樣本的真實性和變異性方面已被證明與人類的評估更加一致。越低的FID值意味著合成數據分布與真實數據分布之間的距離更近。

圖3:基線模型與我們的模型的訓練曲線,利用了我們提出的穩定技術

表1:GAN的Self-Attention與Residual塊的比較。這些塊被添加到網絡的不同層。所有模型都經過100萬次迭代的訓練,并報告較佳的Inception score(IS)和Fréchet初始距離(FID)。

圖4:基線模型和我們的模型隨機生成的128×128圖像樣本

圖5:attention maps的可視化。這些圖像都由SAGAN生成。

與state-of-the-art模型的比較

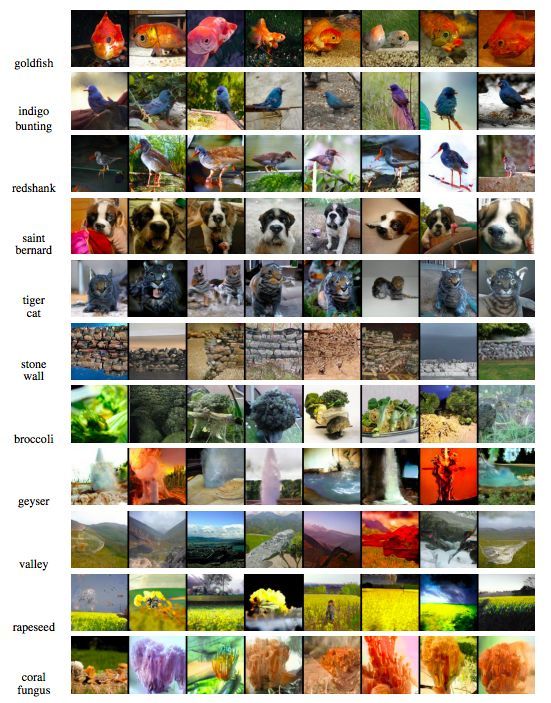

在ImageNet上,SAGAN與較先進的GAN模型[19,17]進行了比較。如表2所示,我們提出的SAGAN得到了Inception score和FID。Inception score方面,SAGAN將此前0較高的36.8提高到52.52;FID(18.65)也表明,SAGAN可以通過使用self-attention模塊對圖像區域之間的全局依賴關系進行建模,從而更好地模擬原始圖像的分布。圖6展示了由SAGAN生成的一些示例圖像。

表2: 將所提出的SAGAN與較先進GAN模型進行比較,任務是ImageNet上的類別條件圖像生成。

圖6:SAGAN 生成的不同類別的128×128分辨率示例圖像。每行展示一個類別的示例。

總結

在本研究中,我們提出自注意力生成對抗網絡(SAGAN),它將self-attention機制引入到GAN的框架。 self-attention 模塊在建模長相關性( long-range dependencies)方面很有效。另外,我們證明了應用于生成器的譜歸一化可以穩定GAN的訓練,并且TTUR加速了正則化鑒別器的訓練。SAGAN在ImageNet的分類條件圖像生成任務上達到較先進的性能。

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://specialneedsforspecialkids.com/yun/4780.html

摘要:作者在論文中將這種新的譜歸一化方法與其他歸一化技術,比如權重歸一化,權重削減等,和梯度懲罰等,做了比較,并通過實驗表明,在沒有批量歸一化權重衰減和判別器特征匹配的情況下,譜歸一化改善生成的圖像質量,效果比權重歸一化和梯度懲罰更好。 就在幾小時前,生成對抗網絡(GAN)的發明人Ian Goodfellow在Twitter上發文,激動地推薦了一篇論文:Goodfellow表示,雖然GAN十分擅長...

摘要:據報道,生成對抗網絡的創造者,前谷歌大腦著名科學家剛剛正式宣布加盟蘋果。他將在蘋果公司領導一個機器學習特殊項目組。在加盟蘋果后會帶來哪些新的技術突破或許我們很快就會看到了。 據 CNBC 報道,生成對抗網絡(GAN)的創造者,前谷歌大腦著名科學家 Ian Goodfellow 剛剛正式宣布加盟蘋果。他將在蘋果公司領導一個「機器學習特殊項目組」。雖然蘋果此前已經縮小了自動駕駛汽車研究的規模,但...

摘要:自年提出生成對抗網絡的概念后,生成對抗網絡變成為了學術界的一個火熱的研究熱點,更是稱之為過去十年間機器學習領域最讓人激動的點子。 自2014年Ian Goodfellow提出生成對抗網絡(GAN)的概念后,生成對抗網絡變成為了學術界的一個火熱的研究熱點,Yann LeCun更是稱之為過去十年間機器學習領域最讓人激動的點子。生成對抗網絡的簡單介紹如下,訓練一個生成器(Generator,簡稱G...

摘要:例如,即插即用生成網絡通過優化結合了自動編碼器損失,損失,和通過與訓練的分類器定于的分類損失的目標函數,得到了較高水平的樣本。該論文中,作者提出了結合的原則性方法。 在機器學習研究領域,生成式對抗網絡(GAN)在學習生成模型方面占據著統治性的地位,在使用圖像數據進行訓練的時候,GAN能夠生成視覺上以假亂真的圖像樣本。但是這種靈活的算法也伴隨著優化的不穩定性,導致模式崩潰(mode colla...

摘要:論文可遷移性對抗樣本空間摘要對抗樣本是在正常的輸入樣本中故意添加細微的干擾,旨在測試時誤導機器學習模型。這種現象使得研究人員能夠利用對抗樣本攻擊部署的機器學習系統。 現在,卷積神經網絡(CNN)識別圖像的能力已經到了出神入化的地步,你可能知道在 ImageNet 競賽中,神經網絡對圖像識別的準確率已經超過了人。但同時,另一種奇怪的情況也在發生。拿一張計算機已經識別得比較準確的圖像,稍作調整,...

閱讀 3496·2021-10-18 13:30

閱讀 2951·2021-10-09 09:44

閱讀 1969·2019-08-30 11:26

閱讀 2299·2019-08-29 13:17

閱讀 765·2019-08-29 12:17

閱讀 2253·2019-08-26 18:42

閱讀 478·2019-08-26 13:24

閱讀 2959·2019-08-26 11:39