資訊專欄INFORMATION COLUMN

摘要:地址為什么使用遷移學習根據聯合創始人斯坦福副教授吳恩達介紹,遷移學習將會成為機器學習商業成就的下一驅動力。遷移學習是一種機器學習技術,允許在特定的數據集上再利用已訓練的卷積神經網絡,并將其調整或遷移到其他數據集。

GitHub 地址:https://github.com/miguelgfierro/sciblog_support/blob/master/A_Gentle_Introduction_to_Transfer_Learning/Intro_Transfer_Learning.ipynb

為什么使用遷移學習?

根據 Coursera 聯合創始人、斯坦福副教授吳恩達介紹,遷移學習(Transfer Learning)將會成為機器學習商業成就的下一驅動力。

遷移學習是一種機器學習技術,允許在特定的數據集上再利用已訓練的卷積神經網絡(CNN),并將其調整或遷移到其他數據集。之所以要復用已經訓練的 CNN,是因為訓練時間太長。例如,在 4 個英偉達 K80 GPU 中將 ResNet18 訓練 30 個 epoch 需要 3 天的時間;而在同樣的 GPU 上將 ResNet152 訓練 120 個 epoch 需要 4 個月。

遷移學習策略

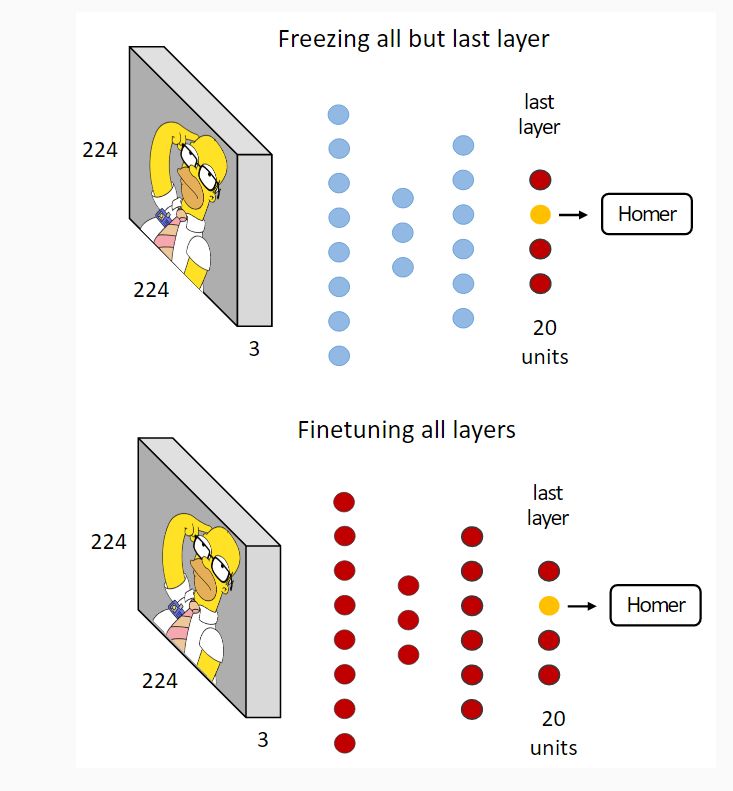

總體而言,遷移學習有兩種策略,不過我還沒有看到關于命名的最終一致意見。微調(finetuning)——其中包括使用基礎數據集上的預訓練網絡以及在目標數據集中訓練所有層;凍結與訓練(freeze and train)——其中包括凍結除最后一層的所有層(權重不更新)并訓練最后一層。也可以凍結前面幾層,然后微調其余層,這是由于一些證據表明 CNN 的前幾層包含紋理過濾器(texture filter)和色彩斑點(color blob)。但是,我們這里的工作只分析兩種極端情況:訓練所有層,以及只訓練最后一層。

最常見的基本數據集是 ImageNet,它包含 120 萬個圖像、1000 個類別。這些類別主要被分為兩大類:動物和物體。每個類別的圖像數量大約為 1000 個。大多數深度學習庫都提供在 ImageNet 上預訓練的 CNN 模型。

在下圖中,我們可以看到上述提到的兩種遷移學習策略。我們在 ImageNet 上使用了一個預訓練的 CNN,并將 Simpsons 數據集的子集 Homer Simpson 作為目標集,用該網絡對其進行分類。這個子集包含 20 個類,每個類有 300-1000 個圖像。

然后,我們可以使用凍結與訓練,只訓練最后一層(如圖上方所示);或者微調所有層(如圖下方所示)。

微調 VS 凍結

我們很難知道在何種情況下應該只訓練最后一層,在何種情況下應該微調網絡。在「How transferable are features in deep neural networks?」(Yosinsky et. al., 2014) 中,作者解決了在 ImageNet 數據集中量化 CNN 特定層普適程度的問題。他們發現,由于層的相互適應,可遷移性會受到中間層分裂的負面影響。隨著任務性質差異的增加,可遷移性的差距會逐漸增長。最終他們發現,通過權重遷移進行網絡初始化,而非從零權重開始訓練,能夠提高泛化性能。

正如 Karpathy 的深度學習教程中指出的,以下是在不同場景中對新數據集使用遷移學習的一些指導原則:

小目標集,圖像相似:當目標數據集與基礎數據集相比較小,且圖像相似時,建議采取凍結和訓練,只訓練最后一層。

大目標集,圖像相似:建議使用微調。

小目標集,圖像不同:建議采取凍結和訓練,訓練最后一層或最后幾層。

大目標集,圖像不同:建議使用微調。

在實驗中,我們使用了有限的幾個數據集,以及一個小型網絡 ResNet18,所以是否能將結果推廣到所有數據集和網絡還言之尚早。但是,這些發現可能會對何時使用遷移學習這一問題提供一些啟示。以下是結果的總結:

我們觀察到的第一個細節是,相比色度數據集而言,訓練灰度數據集準確率會下降。這與其他文章作者觀察一致,即基礎數據集和目標數據集之間的域差異越大,遷移效果越差。

我們同樣發現,對于 Simpson 和 Caltech256 數據集而言,凍結會使得準確率大大下降。這在 Simpson 數據集中可以理解,原因可能是域的區別太大了:在 ImageNet 中都是自然圖像,但在 Simpson 中大多數都是素色的。在 Caltech 數據集中,除了在凍結時產生的準確率下降,我們最先觀察到的是它本身只具有很低的準確率。這可能是因為,對于涵蓋很多類別的數據集,每個類別的圖像太少了,大約每個類只有幾百個而已。

貓狗(dogs vs cats)數據集的域和 ImageNet 最接近。事實上,ImageNet 中就包含著幾個品種的貓和狗。在這種情況下,微調和凍結沒有多大差別。

最后,在膜翅目昆蟲(hymenoptera)數據庫中,我們發現,在凍結時,色度數據集有一點小改善。這可能是因為域很靠近,且數據集比較小。在膜翅目昆蟲灰度數據庫中,凍結就沒有改善,這很可能是由于域的差異。

原文地址:https://miguelgfierro.com/blog/2017/a-gentle-introduction-to-transfer-learning-for-image-classification/

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://specialneedsforspecialkids.com/yun/4695.html

摘要:本篇綜述的重點是回顧當前利用深度神經網絡進行遷移學習的研究及其應用。這篇綜述論文的貢獻如下定義了深度遷移學習,并首次將其分為四類。這就是一個深度遷移學習任務,其中是一個表示深度神經網絡的非線性函數。 論文:A Survey on Deep Transfer Learning論文地址:https://arxiv.org/pdf/1808.01974v1.pdf摘要:作為一種新的分類方法,深度學...

摘要:在本次競賽中,南京信息工程大學和帝國理工學院的團隊獲得了目標檢測的最優成績,最優檢測目標數量為平均較精確率為。最后在視頻目標檢測任務中,帝國理工大學和悉尼大學所組成的團隊取得了較佳表現。 在本次 ImageNet 競賽中,南京信息工程大學和帝國理工學院的團隊 BDAT 獲得了目標檢測的最優成績,最優檢測目標數量為 85、平均較精確率為 0.732227。而在目標定位任務中Momenta和牛津...

摘要:所以,我們美團外賣技術團隊嘗試結合技術,來協助設計師避免這種低收益高重復的任務,同時低成本高效率高質量地完成海報圖片的生成。圖封面配色布局設計在設計領域的一些子問題上,可以用算法來挖掘出數據背后的規律如圖所示。 背景 在視覺設計領域中,設計師們往往會因為一些簡單需求付出相當多的時間,比如修改文案內容,設計簡單的海報版式,針對不同機型、展位的多尺寸拓展等。這些工作需要耗費大量的時間、人力...

閱讀 928·2021-11-23 09:51

閱讀 993·2021-11-18 10:02

閱讀 1908·2021-09-10 11:27

閱讀 3138·2021-09-10 10:51

閱讀 778·2019-08-29 15:13

閱讀 2064·2019-08-29 11:32

閱讀 2501·2019-08-29 11:25

閱讀 3044·2019-08-26 11:46