資訊專欄INFORMATION COLUMN

小編寫這篇文章的主要目的,主要是用來給大家做出一個解答,解答關于Scrapy框架的事情,主要是使用Scrapy框架,爬取網頁,然后保存到一個專業數據庫中,這個數據庫就是Mysql,那么,其具體要怎么實現呢?下面就給大家詳細的解答。

大家好,這一期阿彬給大家分享Scrapy爬蟲框架與本地Mysql的使用。今天阿彬爬取的網頁是虎撲體育網。

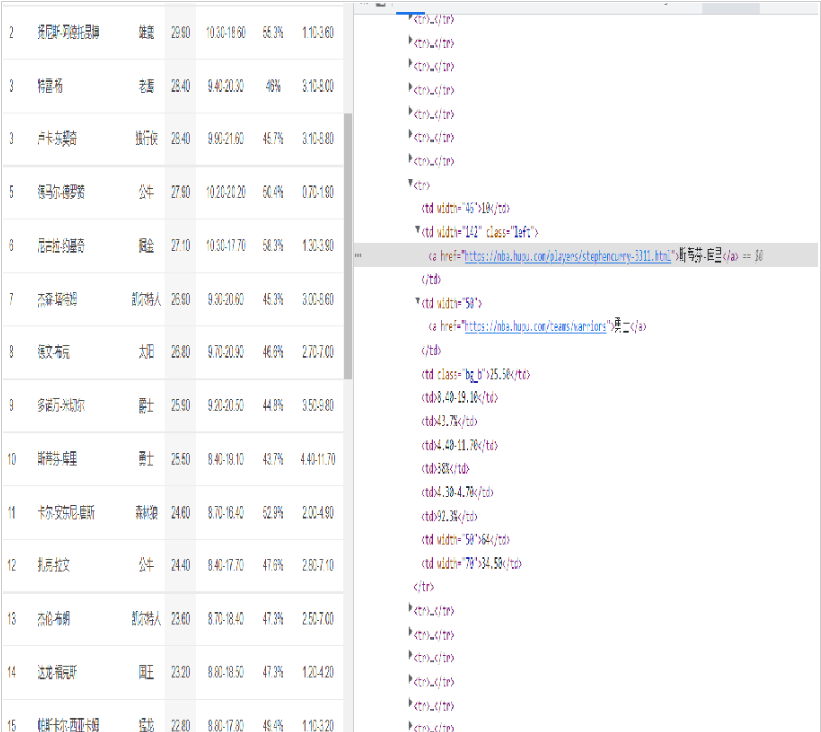

(1)打開虎撲體育網,分析一下網頁的數據,使用xpath定位元素。

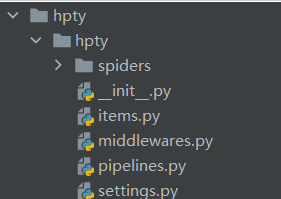

(2)在第一部分析網頁之后就開始創建一個scrapy爬蟲工程,在終端執行以下命令:

“scrapy startproject huty(注:‘hpty’是爬蟲項目名稱)”,得到了下圖所示的工程包:

(3)進入到“hpty/hpty/spiders”目錄下創建一個爬蟲文件叫‘“sww”,在終端執行以下命令:“scrapy genspider sww”(4)在前兩步做好之后,對整個爬蟲工程相關的爬蟲文件進行編輯。1、setting文件的編輯:

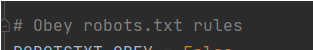

把君子協議原本是True改為False。

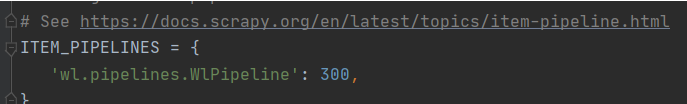

再把這行原本被注釋掉的代碼把它打開。

2、對item文件進行編輯,這個文件是用來定義數據類型,代碼如下:

#Define here the models for your scraped items # #See documentation in: #https://docs.scrapy.org/en/latest/topics/items.html import scrapy class HptyItem(scrapy.Item): #define the fields for your item here like: #name=scrapy.Field() 球員=scrapy.Field() 球隊=scrapy.Field() 排名=scrapy.Field() 場均得分=scrapy.Field() 命中率=scrapy.Field() 三分命中率=scrapy.Field() 罰球命中率=scrapy.Field()

3、對最重要的爬蟲文件進行編輯(即“hpty”文件),代碼如下:

import scrapy

from..items import HptyItem

class SwwSpider(scrapy.Spider):

name='sww'

allowed_domains=['https://nba.hupu.com/stats/players']

start_urls=['https://nba.hupu.com/stats/players']

def parse(self,response):

whh=response.xpath('//tbody/tr[not(class)]')

for i in whh:

排名=i.xpath(

'./td[1]/text()').extract()#排名

球員=i.xpath(

'./td[2]/a/text()').extract()#球員

球隊=i.xpath(

'./td[3]/a/text()').extract()#球隊

場均得分=i.xpath(

'./td[4]/text()').extract()#得分

命中率=i.xpath(

'./td[6]/text()').extract()#命中率

三分命中率=i.xpath(

'./td[8]/text()').extract()#三分命中率

罰球命中率=i.xpath(

'./td[10]/text()').extract()#罰球命中率

data=HptyItem(球員=球員,球隊=球隊,排名=排名,場均得分=場均得分,命中率=命中率,三分命中率=三分命中率,罰球命中率=罰球命中率)

yield data4、對pipelines文件進行編輯,代碼如下:

#Define your item pipelines here

#

#Don't forget to add your pipeline to the ITEM_PIPELINES setting

#See:https://docs.scrapy.org/en/latest/topics/item-pipeline.html

#useful for handling different item types with a single interface

from cursor import cursor

from itemadapter import ItemAdapter

import pymysql

class HptyPipeline:

def process_item(self,item,spider):

db=pymysql.connect(host="Localhost",user="root",passwd="root",db="sww",charset="utf8")

cursor=db.cursor()

球員=item["球員"][0]

球隊=item["球隊"][0]

排名=item["排名"][0]

場均得分=item["場均得分"][0]

命中率=item["命中率"]

三分命中率=item["三分命中率"][0]

罰球命中率=item["罰球命中率"][0]

#三分命中率=item["三分命中率"][0].strip('%')

#罰球命中率=item["罰球命中率"][0].strip('%')

cursor.execute(

'INSERT INTO nba(球員,球隊,排名,場均得分,命中率,三分命中率,罰球命中率)VALUES(%s,%s,%s,%s,%s,%s,%s)',

(球員,球隊,排名,場均得分,命中率,三分命中率,罰球命中率)

)

#對事務操作進行提交

db.commit()

#關閉游標

cursor.close()

db.close()

return item(5)在scrapy框架設計好了之后,先到mysql創建一個名為“sww”的數據庫,在該數據庫下創建名為“nba”的數據表,代碼如下:1、創建數據庫

create database sww;

2、創建數據表

create table nba(球員char(20),球隊char(10),排名char(10),場均得分char(25),命中率char(20),三分命中率char(20),罰球命中率char(20));

3、通過創建數據庫和數據表可以看到該表的結構:

(6)在mysql創建數據表之后,再次回到終端,輸入如下命令:“scrapy crawl sww”,得到的結果

到此為止,這篇文章就為大家解答完畢了,希望可以給大家帶來更多的幫助。

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://specialneedsforspecialkids.com/yun/128244.html

摘要:分布式爬蟲框架詳解隨著互聯網技術的發展與應用的普及,網絡作為信息的載體,已經成為社會大眾參與社會生活的一種重要信息渠道。下載器中間件位于引擎和下載器之間的框架,主要是處理引擎與下載器之間的請求及響應。 scrapy-redis分布式爬蟲框架詳解 隨著互聯網技術的發展與應用的普及,網絡作為信息的載體,已經成為社會大眾參與社會生活的一種重要信息渠道。由于互聯網是開放的,每個人都可以在網絡上...

閱讀 917·2023-01-14 11:38

閱讀 888·2023-01-14 11:04

閱讀 747·2023-01-14 10:48

閱讀 2027·2023-01-14 10:34

閱讀 954·2023-01-14 10:24

閱讀 830·2023-01-14 10:18

閱讀 504·2023-01-14 10:09

閱讀 581·2023-01-14 10:02