資訊專欄INFORMATION COLUMN

摘要:近日,加州大學洛杉磯分校的朱松純教授等人發布了一篇使用決策樹對的表征和預測進行解釋的論文。在此論文中,朱松純等研究者提出了一種新任務,也就是使用決策樹在語義層次上來量化解釋預測的邏輯。

近日,加州大學洛杉磯分校的朱松純教授等人發布了一篇使用決策樹對 CNN 的表征和預測進行解釋的論文。該論文借助決策樹在語義層面上解釋 CNN 做出的每一個特定預測,即哪個卷積核(或物體部位)被用于預測最終的類別,以及其在預測中貢獻了多少。此前,斯坦福大學曾發表了一篇 AAAI 2018 的論文解釋如何用決策樹解釋深度網絡,由此可見可解釋性的決策樹在理解深度網絡的進程中將發揮重要的作用。

卷積神經網絡在許多視覺任務上取得了驚人的表現,例如物體分類和檢測。然而,除了辨別能力,模型可解釋性仍舊是神經網絡的一大挑戰。許多研究提出對 CNN 中隱藏的特征表征進行可視化、分析或者語義化,從而獲得對網絡表征的理解。

在此論文中,朱松純等研究者提出了一種新任務,也就是使用決策樹在語義層次上來量化解釋 CNN 預測的邏輯。注意,這里的決策樹泛指對不同圖像的 CNN 預測生成先驗解釋的「一般性」樹模型。

CNN 記憶多少類模式?

對每個輸入圖像,哪種物體-部位模式被用于預測?

如何量化測量每個物體-部位模式對預測的貢獻度?

解決上面三個問題需要:1)確定卷積層特征圖中每個神經激活值的語義含義;2)量化測量不同神經激活值的貢獻,這對當前最優算法是重大挑戰。

在此論文中,研究者通過略微修正 CNN 而解開表征,并學習一種決策樹來解釋 CNN 的預測。給定特定領域的物體圖像以及隨機圖像作為正例和反例樣本,同時作為學習 CNN 和決策樹的輸入。在此過程中,我們并未標記任何部分或者結構作為附加的監督。首先,我們向 CNN 添加了論文《Interpretable convolutional neural networks》中提出的卷積核損失函數。其次,我們創造了一種決策樹來量化解釋對輸入圖像的決策模式,也就是哪個物體部位(卷積核)被用在預測中,貢獻度有多大。

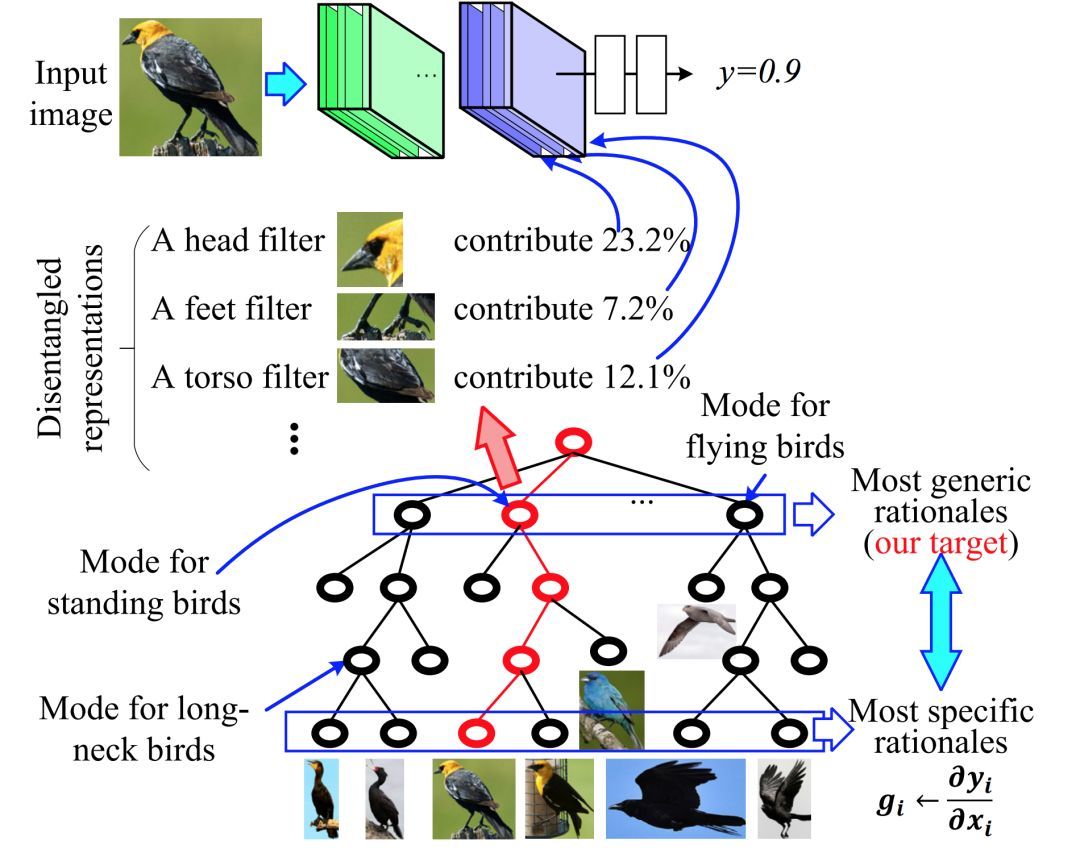

如下圖 1 所示,決策樹中的每個節點表示特定的決策模式,且該決策樹以由粗到細的方式組織所有的決策模式。接近頂部根節點表征許多樣本共享的通用決策模式。接近葉節點對應少數樣本的細粒模式。特別是每個葉節點對應于 CNN 的輸出關于圖像中不同物體部位的梯度。

圖 1. 在語義層次上解釋 CNN 預測的決策樹。我們學習到一種分類物體的 CNN,帶有頂部卷積層的解開表征,其中每個過濾層表征一個特定的物體部位。以一種由粗到精的方式,決策樹解碼 CNN 全連接層中隱藏的各種決策模式。給定一張輸入圖像,我們推斷出一種解析樹(紅線)來量化分析 CNN 預測的基本原理,例如,哪些物體部位(或者過濾層)被用于預測,且其對預測的貢獻度是多少。我們對總結低層節點并提供 CNN 預測緊密邏輯的高層決策模式更感興趣。

因此如上所述,在這篇論文中,研究者們關注了一項新任務,即解開 CNN 的表征內容,并學習一個決策樹以量化地解釋每一個 CNN 預測的邏輯。他們提出了一種簡單但高效的方法以在不使用標注的信息下學習一個決策樹,因此可以在不使用物體部位作為額外的監督而實現學習 CNN 的過程。從理論上來說,研究者的方法是一種修正 CNN 的廣泛技術,它能學到緊密耦合的 CNN 和決策樹。實踐上也證明了這種基于 VGG 網絡方法的高效性。

論文:Interpreting CNNs via Decision Trees

論文地址:https://arxiv.org/abs/1802.00121

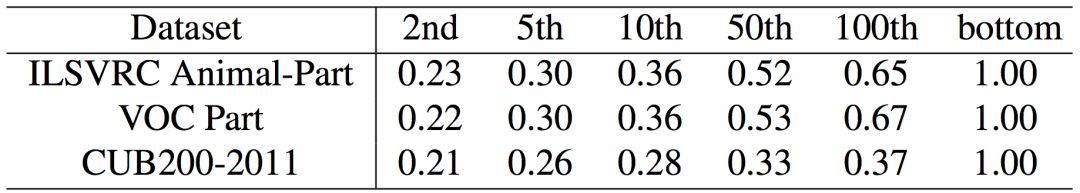

本文提出的方法可通過學習決策樹從而量化地解釋預訓練卷積神經網絡(CNNs)每一預測的內在邏輯。我們的方法從兩個方面提升了神經網絡的可解釋性。1) 在 CNN 中,高層卷積層之中的每一個過濾層必須表征一個特定的物體部位,而不是描述無明確含義的混合模式。2) 人們可以借助決策樹在語義層面上解釋 CNN 做出的每一個特定預測,即哪個過濾層(或物體部位)被用于預測,以及其在預測中貢獻了多少。為了對 CNN 做出量化解釋,我們的方法學習 CNN 高層卷積層中物體部位的明確表征,并挖掘存儲在全連接層之中的潛在決策模式。決策樹按照由粗到細的方式組織這些潛在的決策模式。最后,我們的實驗表明了這一方法的有效性。

3. 算法

3.1. 準備工作:學習帶有解開(disentangled)表征的 CNN

通過在頂部卷積層為每一個過濾層添加損失,[30] 獲得了已學習的 CNN 解開表征,從而把過濾層的表征推向了一個特定的物體部位。注意人們無需為監督標注物體部位。CNN 在端到端學習期間自動為每一個過濾層分配一個特定部位。

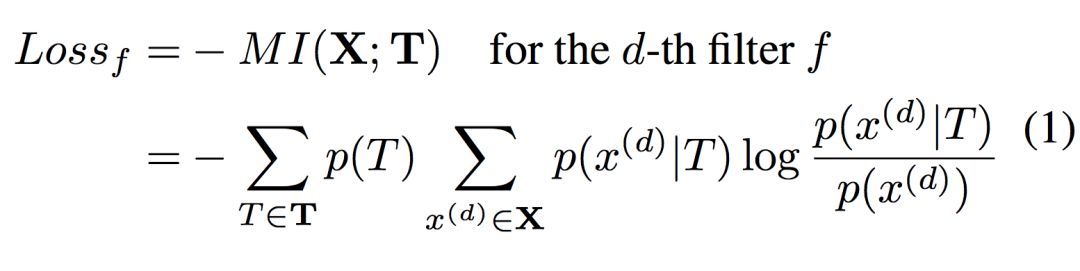

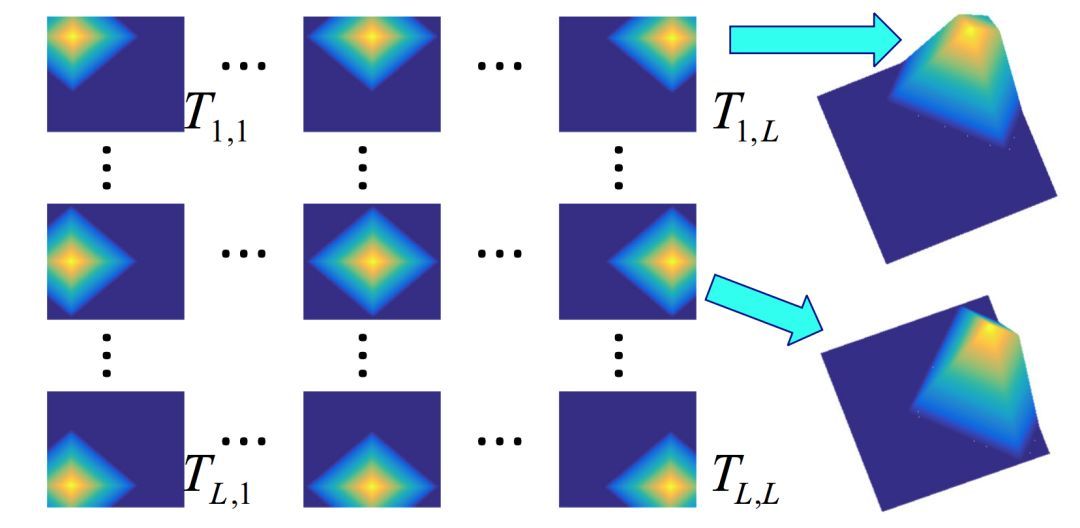

如圖 2 所示,人們為正樣本設計 L^2 正模板 T^+ = {T_1,1, T_1,2, . . . , T_L,L} 以表征當濾波器 f 的物體部位出現在 x^(d) 上的 L^2 個不同位置候選處時的理想激活形狀。負模板 T^?同樣用于描述負樣本上的特征圖。過濾層 f 的損失是作為所有特征圖和所有模板之間的負互信息給出的。

其中 X 表征所有訓練樣本上過濾層 f 的特征圖的集合,T 表征所有的 L^2 + 1 模板。先驗概率 p(T) 被定義為一個常量。

圖 2:過濾層 f 的特征圖的正模板。每個模板表征當過濾層 f 的物體部位出現在特定的圖位置時的理想激活形狀。

3.2. 學習一個決策樹

過濾層中的部位概念:等式 (1) 中的損失確保每個過濾層表征一個特定的物體部位。讓我們聚焦在有特定過濾層 f 所產生的特征圖 xi , x ^(d)_ i ∈ R^L×L 的第 d 個通道,該通道表征一個解開的物體部位。我們可以把等式 (1) 中的過濾層損失重寫為

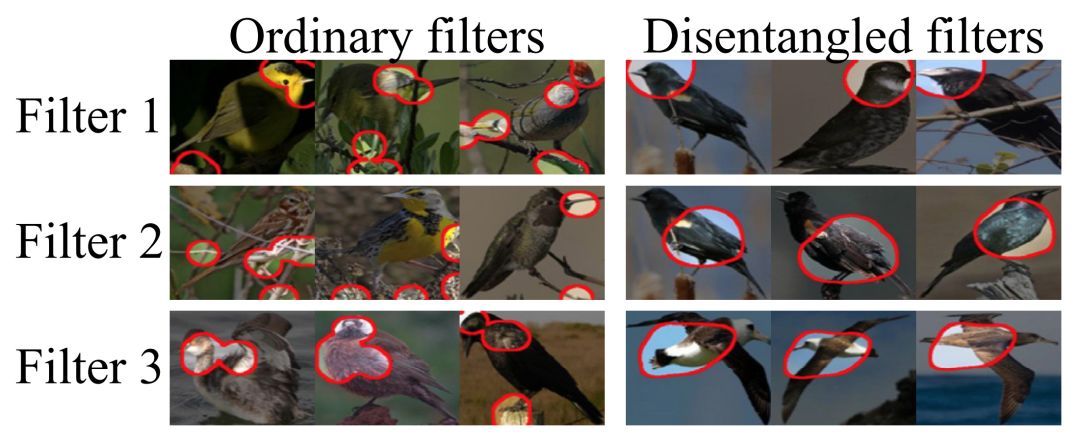

如圖 3 所示,這一損失確保第 d 個過濾層 f 表征目標物體的一個部位。

圖 3:普通 CNN 特征圖與本研究中使用的解開特征圖之間的對比。我們可視化對應于每一特征圖的圖像區域。

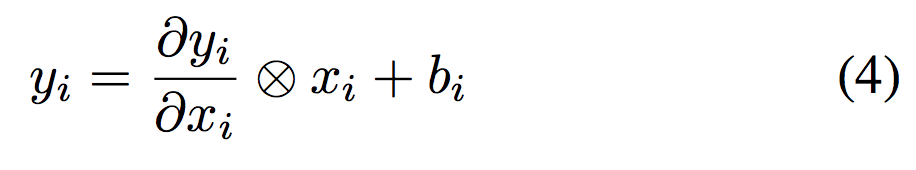

CNN 預測的內在邏輯:如 [21] 所述,全連接層中為 I_i 編碼的決策模式可以大致為分段線性表征所描述:

其中?表示卷積。關于特征圖的梯度 partial y_i 除以 partial x_i 可通過梯度反向傳播計算。

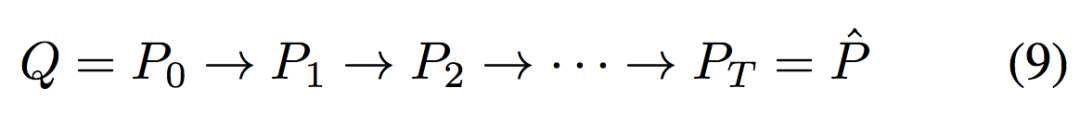

樹:如圖 4 所示,我們提取編碼在 CNN 全連接層之中的決策模式,并構建一個決策樹以組織決策模式的層級。從頂部節點到終端節點,決策樹通過由粗到細的方式編碼決策模式。

圖 4:決策樹的學習過程。P_3 中的紅線表示解析樹以解釋給定圖像 I 的原理。

學習:決策樹學習的基本思想是從不同樣本的特定決策模式中總結常見的決策模式,從而表征 CNN 預測的基本原理。

開始時,通過設定 和α = 1,我們把每一個正樣本 I_i 的梯度 g_i 初始化為一個終端節點。因此如圖 4 所示,我們構建了一個初始樹 Q,其中頂部節點把所有正樣本的梯度作為后代。接著,在每一步中,我們在第二個層中選擇并合并兩個節點 v, v0 ∈ V(即,頂部節點的后代)以獲得一個新節點 u,其中 V 表征第二層中的節點集合。v 和 v^"成為了 u 的后代,并且 u 替代 v 和 v^"成為了頂部節點的新后代。通過這種方式,在 T 合并操作之后我們逐漸把初始樹 P_0 = Q 修改為最后的決策樹:

和α = 1,我們把每一個正樣本 I_i 的梯度 g_i 初始化為一個終端節點。因此如圖 4 所示,我們構建了一個初始樹 Q,其中頂部節點把所有正樣本的梯度作為后代。接著,在每一步中,我們在第二個層中選擇并合并兩個節點 v, v0 ∈ V(即,頂部節點的后代)以獲得一個新節點 u,其中 V 表征第二層中的節點集合。v 和 v^"成為了 u 的后代,并且 u 替代 v 和 v^"成為了頂部節點的新后代。通過這種方式,在 T 合并操作之后我們逐漸把初始樹 P_0 = Q 修改為最后的決策樹:

整體如下:

3.3 解釋 CNN

給定一個測試圖像 I_i,我們使用 CNN 以預測 y_i。我們使用決策樹對預測的基本原理進行蓮花的計算。在推斷過程中,我們能自上而下構建一棵解析樹,圖 4 中的紅線展示了這樣的解析樹。如果讀者希望了解更多解釋 CNN 預測類別的過程,請查看原論文的該章節。

4. 實驗

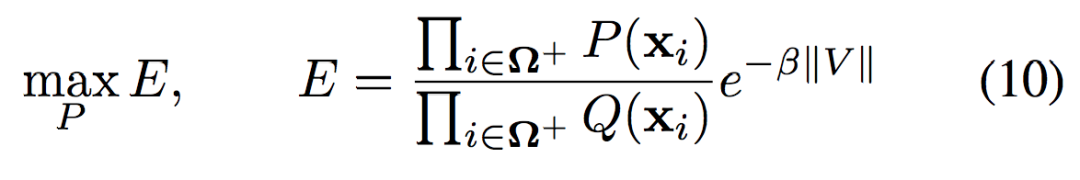

表 1:在決策樹第 2、5、10、50 和 100 層的平均節點數。

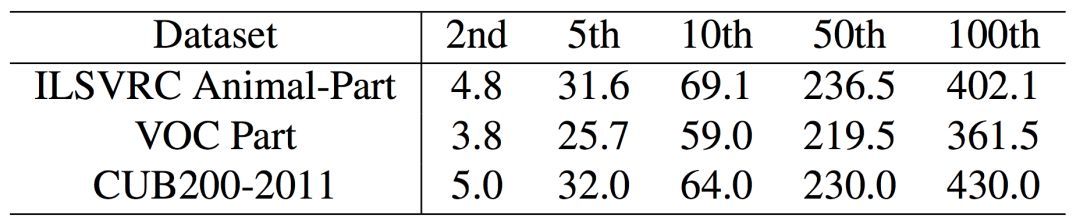

表 2:在決策樹第 2、5、10、50、100 和底層上的平均分類準確度。

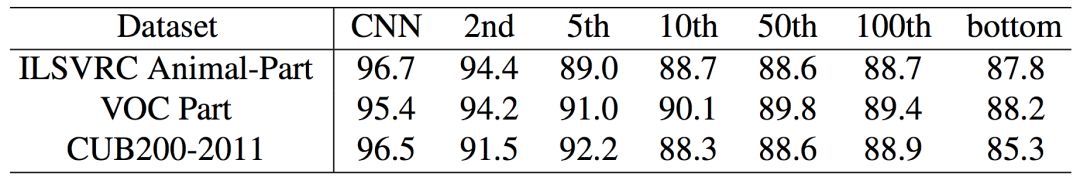

表 3:在決策樹第 2、5、10、50、100 和底層節點上的平均預測誤差。

表 4:在決策樹第 2、5、10、50、100 和底層節點上對卷積核擬合度的平均貢獻。

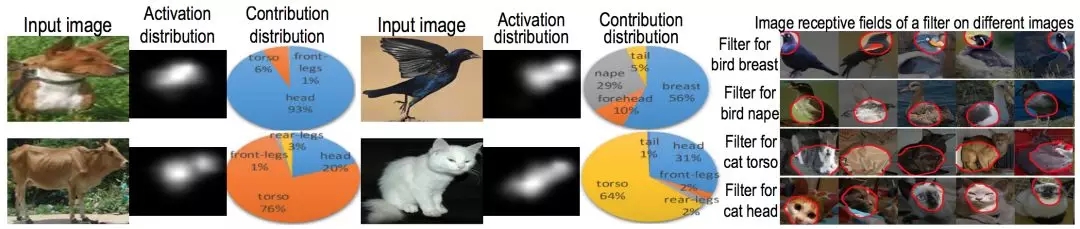

上表 1 展示了決策樹的結構,其余展示了各層級的特性。下圖 5 可視化了決策樹中的決策模式,而圖 6 展示了物體部位的分布對 CNN 預測的貢獻,該貢獻通過使用決策樹第二層節點進行估計。

一般來說,當我們使用更加細粒度的決策模式來解釋預測邏輯時,該解釋將更好地擬合 CNN 中的實際邏輯,并且使用決策模式預測 y_i 的誤差也會降低。然而,更加細粒度的決策模式并不會展現更高的分類準確率,因為我們方法的目標是總結預訓練 CNN 模型的決策模式,而不是提升分類準確度。

圖 5:可視化決策樹第二層節點所對應的決策模式,我們展示了每一個決策模式中的典型樣本。

圖 6:對 CNN 預測的物體-部位貢獻。餅圖展示了不同部位的貢獻比例,它們都通過第二層節點進行估計。熱力圖表示頂部卷積層的神經元激活值分布,該熱力圖并不代表「貢獻」的分布,因為神經元激活值并沒有被 g_i 加權。右圖為不同卷積核的圖像感受野。基于這些感受卷積核,我們可以通過不同的物體部位分配卷積核,因而能計算物體部位的貢獻。

本論文再最后的結語中表明,決策樹理論上只為 CNN 的預測提供近似的解釋,它不會對 CNN 的表征細節進行準確的重構。首先,我們并沒有準確的物體-部位標注以監督 CNN 的學習,[30] 只能粗略地令每個卷積核表征一個物體部位。而卷積核在一些困難的樣本中也可能生成不正確的激活值。其次,每一個節點的決策模式忽略非顯著性的物體-部位模式(卷積核)以確保決策模式的稀疏表征。

歡迎加入本站公開興趣群商業智能與數據分析群

興趣范圍包括各種讓數據產生價值的辦法,實際應用案例分享與討論,分析工具,ETL工具,數據倉庫,數據挖掘工具,報表系統等全方位知識

QQ群:81035754

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://specialneedsforspecialkids.com/yun/4733.html

摘要:隨著復雜和高效的神經網絡架構的出現,卷積神經網絡的性能已經優于傳統的數字圖像處理方法,如和。子網絡由多個卷積層組成,而子網絡由幾個完全連接層組成。結論總而言之,模型用信號分析的角度為我們剖析了卷積神經網絡。 隨著復雜和高效的神經網絡架構的出現,卷積神經網絡(CNN)的性能已經優于傳統的數字圖像處理方法,如 SIFT 和 SURF。在計算機視覺領域,學者們開始將研究重點轉移到 CNN,并相信 ...

摘要:本論文將嘗試概述卷積網絡的架構,并解釋包含激活函數損失函數前向傳播和反向傳播的數學推導。本文試圖只考慮帶有梯度下降優化的典型卷積神經網絡架構的制定。 近日南洋理工大學研究者發布了一篇描述卷積網絡數學原理的論文,該論文從數學的角度闡述整個卷積網絡的運算與傳播過程。該論文對理解卷積網絡的數學本質非常有幫助,有助于讀者「徒手」(不使用卷積API)實現卷積網絡。論文地址:https://arxiv....

早期成果卷積神經網絡是各種深度神經網絡中應用最廣泛的一種,在機器視覺的很多問題上都取得了當前較好的效果,另外它在自然語言處理,計算機圖形學等領域也有成功的應用。第一個真正意義上的卷積神經網絡由LeCun在1989年提出[1],后來進行了改進,它被用于手寫字符的識別,是當前各種深度卷積神經網絡的鼻祖。接下來我們介紹LeCun在早期提出的3種卷積網絡結構。?文獻[1]的網絡由卷積層和全連接層構成,網絡...

閱讀 1951·2021-09-07 10:24

閱讀 2086·2019-08-30 15:55

閱讀 2037·2019-08-30 15:43

閱讀 668·2019-08-29 15:25

閱讀 1043·2019-08-29 12:19

閱讀 1927·2019-08-23 18:32

閱讀 1515·2019-08-23 17:59

閱讀 946·2019-08-23 12:22