資訊專欄INFORMATION COLUMN

項目簡介

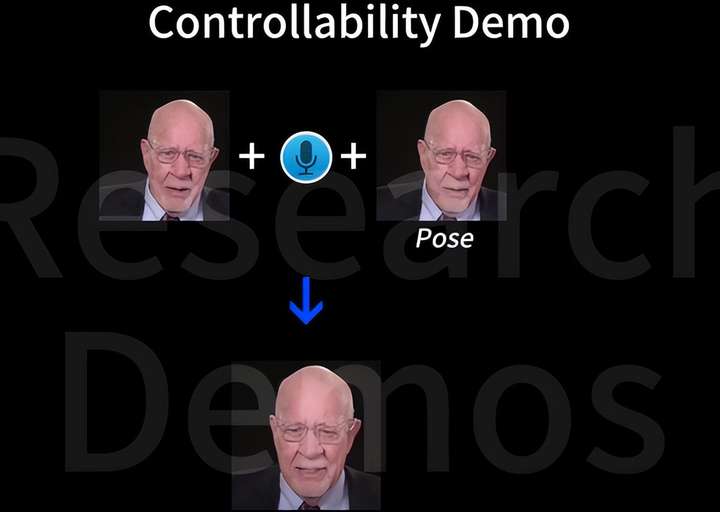

AniTalker是一個開源項目,它利用靜態照片和音頻文件來創造動態的面部說話視頻。

AniTalker采用了一種通用的運動表示方法。這種創新的表示方法有效地捕捉了廣泛的面部動態,包括微妙的表情和頭部動作。

AniTalker通過兩種自監督學習策略增強了運動描述:第一種策略是通過同一身份內的源幀重建目標視頻幀來學習微妙的運動表示;第二種策略是使用度量學習開發身份編碼器,同時積極減少身份和運動編碼器之間的互信息。

這種方法確保了運動表示是動態的,并且不包含特定身份的細節,顯著減少了對標記數據的需求。

功能特點

動態視頻創作

AniTalker能夠將靜態圖像轉化為動態視頻,其中不僅包括口型與音頻的精準匹配,還涵蓋了豐富的面部表情和頭部動作。

個性化動畫

用戶可以根據個人喜好和需求,調整參數,定制出具有個性化表情和動作的面部動畫。

高度仿真

這項技術能夠捕捉到面部的微小動作,如眨眼和微笑,從而制作出具有高度仿真感的動態視頻。

支持長視頻

AniTalker支持制作超過3分鐘的長視頻,這使得它非常適合用于創建虛擬助手、數字角色表演等應用場景。

項目實操

預裝環境

conda create -n anitalker python==3.9.0 conda activate anitalker conda install pytorch==1.8.0 torchvision==0.9.0 torchaudio==0.8.0 cudatoolkit=11.1 -c pytorch -c conda-forge pip install -r requirements.txt

演示腳本

python ./code/demo_audio_generation.py \ --infer_type 'mfcc_pose_only' \ --stage1_checkpoint_path 'ckpts/stage1.ckpt' \ --stage2_checkpoint_path 'ckpts/stage2_pose_only.ckpt' \ --test_image_path 'test_demos/portraits/monalisa.jpg' \ --test_audio_path 'test_demos/audios/english_female.wav' \ --result_path 'results/monalisa_case1/' \ --control_flag True \ --seed 0 \ --pose_yaw 0 \ --pose_pitch 0 \ --pose_roll 0

項目地址:

https://github.com/X-LANCE/AniTalker

推薦使用NVIDIA RTX 40 顯卡做模型推理,購買地址如下:

http://specialneedsforspecialkids.com/site/active/gpu.html?ytag=seo

https://www.compshare.cn/?ytag=seo

文章版權歸作者所有,未經允許請勿轉載,若此文章存在違規行為,您可以聯系管理員刪除。

轉載請注明本文地址:http://specialneedsforspecialkids.com/yun/131099.html

Llama3 中文聊天項目綜合資源庫,該文檔集合了與Lama3 模型相關的各種中文資料,包括微調版本、有趣的權重、訓練、推理、評測和部署的教程視頻與文檔。1. 多版本支持與創新:該倉庫提供了多個版本的Lama3 模型,包括基于不同技術和偏好的微調版本,如直接中文SFT版、Instruct偏好強化學習版、趣味版等。此外,還有Phi3模型中文資料倉庫的鏈接,和性能超越了8b版本的Llama3。2. 部...

摘要:阿里云服務器平臺在云端提供統一硬件平臺與中間件,可大大降低加速器的開發與部署成本。我們相信,通過即開即用的硬件資源統一的軟硬件邏輯開發接口和市場,阿里云能夠真正兌現計算資源平民化的承諾。 阿里云ECS的異構計算團隊和高性能計算團隊一直致力于將計算資源平民化;高性能計算團隊在做的E-HPC就是要讓所有云上用戶都能夠瞬間擁有一個小型的超算集群,使得超算不再僅僅是一些超算中心和高校的特權;而...

閱讀 157·2024-12-10 11:51

閱讀 303·2024-11-07 17:59

閱讀 330·2024-09-27 16:59

閱讀 466·2024-09-23 10:37

閱讀 540·2024-09-14 16:58

閱讀 336·2024-09-14 16:58

閱讀 532·2024-08-29 18:47

閱讀 813·2024-08-16 14:40