資訊專欄INFORMATION COLUMN

在人工智能領(lǐng)域,自然語言處理技術(shù)一直備受關(guān)注。就在昨日,今年備受關(guān)注的國內(nèi)AI公司北京智譜AI發(fā)布了第四代 GLM 系列開源模型:GLM-4-9B。這是一個集成了先進自然語言處理技術(shù)的創(chuàng)新平臺,它憑借清華大學(xué)KEG實驗室提出的GLM模型結(jié)構(gòu),為智能體功能的發(fā)展帶來了新的突破的同時所有大模型全部保持開源,一系列商業(yè)化成果、技術(shù)突破讓人眼前一亮。讓我們一起揭開GLM-4的神秘面紗,探索其在代碼執(zhí)行、聯(lián)網(wǎng)瀏覽、畫圖等領(lǐng)域的無限可能。

模型介紹

對于將構(gòu)建 AGI 視為目標的智譜 AI 而言,不斷迭代大模型技術(shù)能力,同樣是重中之重。

自 2020 年 all In 大模型開始,智譜就一直走在人工智能浪潮的前沿。其研究涉及大模型技術(shù)的方方面面,從原創(chuàng)的預(yù)訓(xùn)練框架 GLM、國產(chǎn)算力適配、通用基座大模型,到語義推理、多模態(tài)生成,再到長上下文、視覺理解、Agent 智能體能力等各個方面,智譜都投入了相當(dāng)多的資源來推動技術(shù)的原始創(chuàng)新。

在過去一年里,智譜相繼推出了四代通用大模型:2023 年 3 月發(fā)布 ChatGLM,6 月推出 ChatGLM2,去年 10 月推出 ChatGLM3;今年 1 月,最新一代基座大模型 GLM-4 正式發(fā)布。在 Open Day 上,智譜 AI 向外界介紹了基座大模型 GLM-4 的最新開源成果 ——GLM-4-9B。

它是智譜 AI 推出的最新一代預(yù)訓(xùn)練模型 GLM-4 系列中的開源版本。在語義、數(shù)學(xué)、推理、代碼和知識等多方面的數(shù)據(jù)集測評中, GLM-4-9B 及其人類偏好對齊的版本 GLM-4-9B-Chat 均表現(xiàn)出超越 Llama-3-8B 的卓越性能。除了能進行多輪對話,GLM-4-9B-Chat 還具備網(wǎng)頁瀏覽、代碼執(zhí)行、自定義工具調(diào)用(Function Call)和長文本推理(支持最大 128K 上下文)等高級功能,并首次擁有多模態(tài)能力。

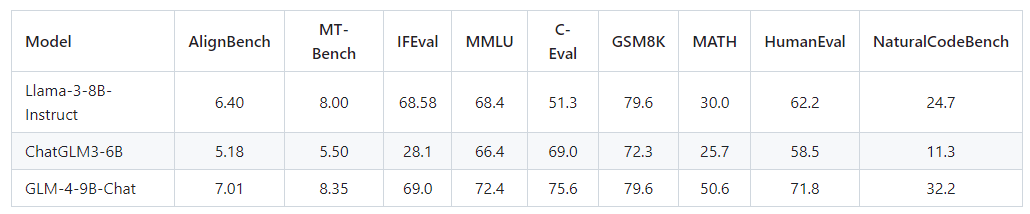

基于強大的預(yù)訓(xùn)練基座,GLM-4-9B 的中英文綜合性能相比 ChatGLM3-6B 提升了 40%,在中文對齊能力 AlignBench、指令遵從 IFeval、工程代碼 Natural Code Bench 等基準數(shù)據(jù)上都取得了非常顯著的提升。對比訓(xùn)練量更大的 Llama 3 8B 也并不遜色,英文方面實現(xiàn)小幅領(lǐng)先,中文學(xué)科方面更是有著高達 50% 的提升。

主要功能和特點

模型性能:在語義、數(shù)學(xué)、推理、代碼和知識等數(shù)據(jù)集評測中,GLM-4-9B及其對齊版本GLM-4-9B-Chat表現(xiàn)優(yōu)于Llama-3-8B。

高級功能:GLM-4-9B-Chat支持多輪對話、網(wǎng)頁瀏覽、代碼執(zhí)行、自定義工具調(diào)用和長文本推理,最大支持128K上下文長度。

多語言支持:支持包括日語、韓語、德語在內(nèi)的26種語言。

長文本支持:GLM-4-9B-Chat-1M模型支持1M上下文長度,約200萬中文字符。

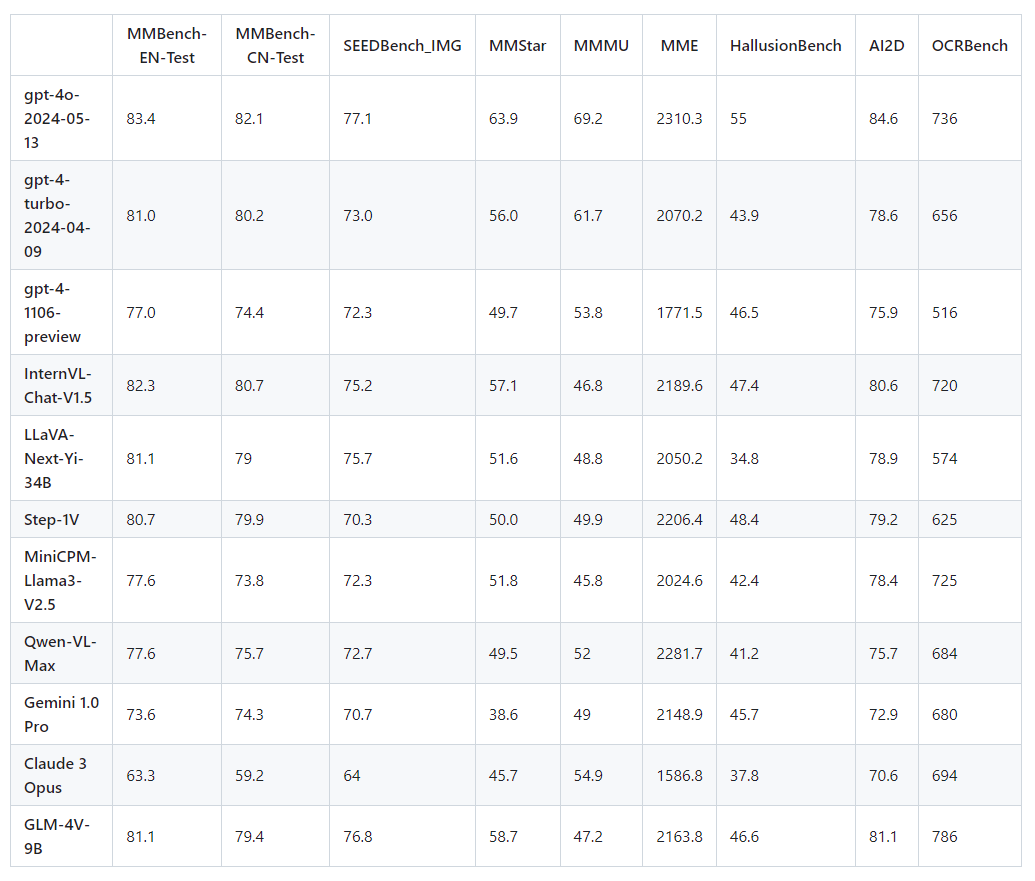

多模態(tài)支持:基于GLM-4-9B的多模態(tài)模型GLM-4V-9B,具備1120×1120高分辨率下的中英雙語多輪對話能力,在中英文綜合能力、感知推理、文字識別和圖表理解等多方面表現(xiàn)卓越,超越多個現(xiàn)有先進模型。

用戶自定義:用戶可以根據(jù)自己的需求,為GLM-4智能體添加更多功能,打造屬于自己的個性化智能體

模型評測結(jié)果

對話模型

基座模型

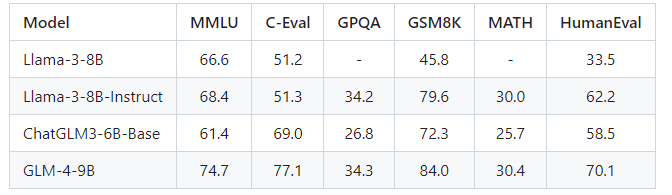

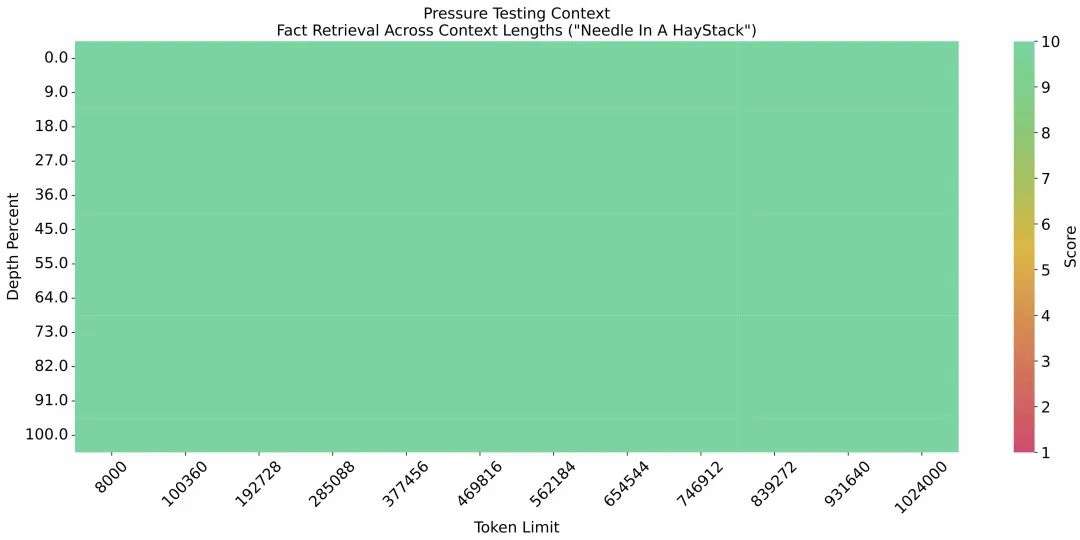

長文本模型

在上下文長度為1M的情況下進行大海撈針實驗,結(jié)果如下:

在LongBench-Chat上進一步評估長文本能力,結(jié)果如下:

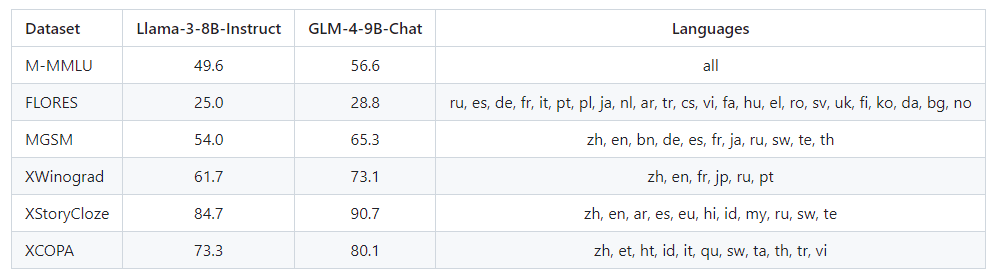

多語言

GLM-4-9B-Chat 和 Llama-3-8B-Instruct 的測試在六個多語言數(shù)據(jù)集上進行。測試結(jié)果以及每個數(shù)據(jù)集選擇的對應(yīng)語言如下表所示:

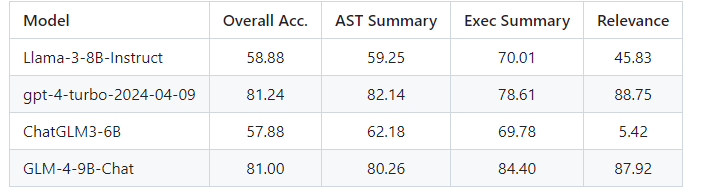

函數(shù)調(diào)用

多模態(tài)

GLM-4V-9B是一種具有視覺理解能力的多模態(tài)語言模型。其相關(guān)經(jīng)典任務(wù)的評測結(jié)果如下:

由此可見,GLM-4-9B和GLM-4V-9B在多項評測中表現(xiàn)優(yōu)異,包括對話模型典型任務(wù)、基座模型典型任務(wù)、長文本能力、多語言能力和工具調(diào)用能力。

相關(guān)鏈接

LLaMA-Factory: 高效開源微調(diào)框架,已支持 GLM-4-9B-Chat 語言模型微調(diào)。

SWIFT: 魔搭社區(qū)的大模型/多模態(tài)大模型訓(xùn)練框架,已支持 GLM4-9B-Chat/GLM4v-9B-Chat 模型微調(diào)。

Xorbits Inference: 性能強大且功能全面的分布式推理框架,輕松一鍵部署你自己的模型或內(nèi)置的前沿開源模型。

self-llm: Datawhale 團隊的提供的 GLM-4-9B 系列模型使用教程。

推薦使用NVIDIA RTX 40 顯卡做模型推理,購買地址如下:

http://specialneedsforspecialkids.com/site/active/gpu.html?ytag=seo

文章版權(quán)歸作者所有,未經(jīng)允許請勿轉(zhuǎn)載,若此文章存在違規(guī)行為,您可以聯(lián)系管理員刪除。

轉(zhuǎn)載請注明本文地址:http://specialneedsforspecialkids.com/yun/131112.html

GLM-4-Plus是智譜AI最新推出的旗艦級預(yù)訓(xùn)練語言模型,標志著公司在人工智能技術(shù)上取得了重大突破。相比前一代GLM-3模型,GLM-4-Plus在多個關(guān)鍵指標上實現(xiàn)了大幅提升,尤其是在語言理解能力、指令遵循能力和長文本處理能力方面。這些進步使得GLM-4-Plus在各類自然語言處理任務(wù)中的表現(xiàn)更加出色。主要更新語言基座模型 GLM-4-Plus:在語言理解、指令遵循、長文本處理等方面性能得到...

Llama3 中文聊天項目綜合資源庫,該文檔集合了與Lama3 模型相關(guān)的各種中文資料,包括微調(diào)版本、有趣的權(quán)重、訓(xùn)練、推理、評測和部署的教程視頻與文檔。1. 多版本支持與創(chuàng)新:該倉庫提供了多個版本的Lama3 模型,包括基于不同技術(shù)和偏好的微調(diào)版本,如直接中文SFT版、Instruct偏好強化學(xué)習(xí)版、趣味版等。此外,還有Phi3模型中文資料倉庫的鏈接,和性能超越了8b版本的Llama3。2. 部...

Llama3-8B-Chinese-Chat 是基于 Meta-Llama-3-8B-Instruct 模型通過 ORPO進行微調(diào)的中文聊天模型。與原始的 Meta-Llama-3-8B-Instruct 模型相比,此模型顯著減少了中文問題英文回答"和混合中英文回答的問題。此外,相較于原模型,新模型在回答中大量減少了表情符號的使用,使得回應(yīng)更加正式。與 Llama-3-8B-nsturc...

閱讀 157·2024-12-10 11:51

閱讀 303·2024-11-07 17:59

閱讀 329·2024-09-27 16:59

閱讀 466·2024-09-23 10:37

閱讀 540·2024-09-14 16:58

閱讀 335·2024-09-14 16:58

閱讀 531·2024-08-29 18:47

閱讀 812·2024-08-16 14:40